모두연 서비스 바로가기

모두연 KDT

모두의연구소 아이펠 부트캠프

모두연 온라인 교육상품

모두의연구소 추천 강의

AI와 함께 코딩하자! 인공지능/데이터 커리어 첫걸음

90%20,570원

205,700원- #NEW

- #바이브코딩

- #🪙국비지원

비개발자도 할 수 있는 바이브 코딩 웹 개발

90%23,700원

237,000원- #🐥왕초보

- #바이브코딩

- #🪙국비지원

바이브 코딩 with Cursor: 챗봇, DB 배포까지

90%17,900원

179,000원- #NEW

- #바이브코딩

- #🪙국비지원

비개발자도 할 수 있는 바이브 코딩 업무 자동화

90%25,410원

254,100원- #바이브코딩

- #🪙국비지원

AI by Hand: 내 손으로 이해하는 딥러닝 기초수학

90%18,150원

181,500원- #NEW

- #AI수학

- #🪙국비지원

![[첫걸음] 기본부터 탄탄하게, 파이썬 데이터 분석 첫 만남](/_next/image?url=https%3A%2F%2Fresources-public-prd.modulabs.co.kr%2Fhome-section%2Fmain-online-kdc%2Fd1a26177-0d9a-4d92-af84-062736818557.jpg&w=3840&q=75)

[첫걸음] 기본부터 탄탄하게, 파이썬 데이터 분석 첫 만남

90%13,700원

137,000원- #🐥왕초보

- #🪙국비지원

일상부터 업무까지: ChatGPT와 친해지기

90%23,700원

237,000원- #🐥왕초보

- #🪙국비지원

AI로 시작하는 콘텐츠 크리에이터

90%20,000원

200,000원- #🪙국비지원

함께 성장하는 즐거움, 모두모임

![[모두의연구소 AI Agent 세미나 with 밋업] 비개발자의 첫 AI 에이전트, 이렇게 만들면 됩니다!](/_next/image?url=https%3A%2F%2Fresources-public-prd.modulabs.co.kr%2Fmomo%2Fthumbnail%2Fc7fcab92-cb24-49ff-b36e-95ae933d2f66.png&w=3840&q=100)

홍민지

모집완료[모두의연구소 AI Agent 세미나 with 밋업] 비개발자의 첫 AI 에이전트, 이렇게 만들면 됩니다!

세미나무료모임![[모두팝/오프라인] 양자컴퓨팅과 AI의 만남: 양자컴퓨터를 활용한 AI 서비스와 글로벌 사례 with 노르마](/_next/image?url=https%3A%2F%2Fresources-public-prd.modulabs.co.kr%2Fmomo%2Fthumbnail%2Fb3ad0521-fb66-4368-98e7-8d7f799b2186.png&w=3840&q=100)

모두의연구소 기업교육

모집완료[모두팝/오프라인] 양자컴퓨팅과 AI의 만남: 양자컴퓨터를 활용한 AI 서비스와 글로벌 사례 with 노르마

세미나무료모임![[모두팝/온라인] 양자컴퓨팅과 AI의 만남: 양자컴퓨터를 활용한 AI 서비스와 글로벌 사례 with 노르마](/_next/image?url=https%3A%2F%2Fresources-public-prd.modulabs.co.kr%2Fmomo%2Fthumbnail%2F5214c166-d744-4993-a55b-620ec0221206.png&w=3840&q=100)

모두의연구소 기업교육

모집완료[모두팝/온라인] 양자컴퓨팅과 AI의 만남: 양자컴퓨터를 활용한 AI 서비스와 글로벌 사례 with 노르마

세미나무료모임![[무료 웨비나] AI 캐릭터 숏폼 클래스 - 프롬프트부터 완성까지](/_next/image?url=https%3A%2F%2Fresources-public-prd.modulabs.co.kr%2Fmomo%2Fthumbnail%2F1384b00f-a055-40f0-8005-af8c4003b704.png&w=3840&q=100)

모두연 커뮤니티

모집완료[무료 웨비나] AI 캐릭터 숏폼 클래스 - 프롬프트부터 완성까지

세미나무료모임![[무료] Cursor로 웹서비스 만들기 - 바이브 코딩 스터디 설명회](/_next/image?url=https%3A%2F%2Fresources-public-prd.modulabs.co.kr%2Fmomo%2Fthumbnail%2F020c42f8-10f9-404f-af94-c5d6e3cb448c.png&w=3840&q=100)

모두의연구소 클래스

[무료] Cursor로 웹서비스 만들기 - 바이브 코딩 스터디 설명회

세미나무료모임

모두연 세미나

모두의연구소 세미나

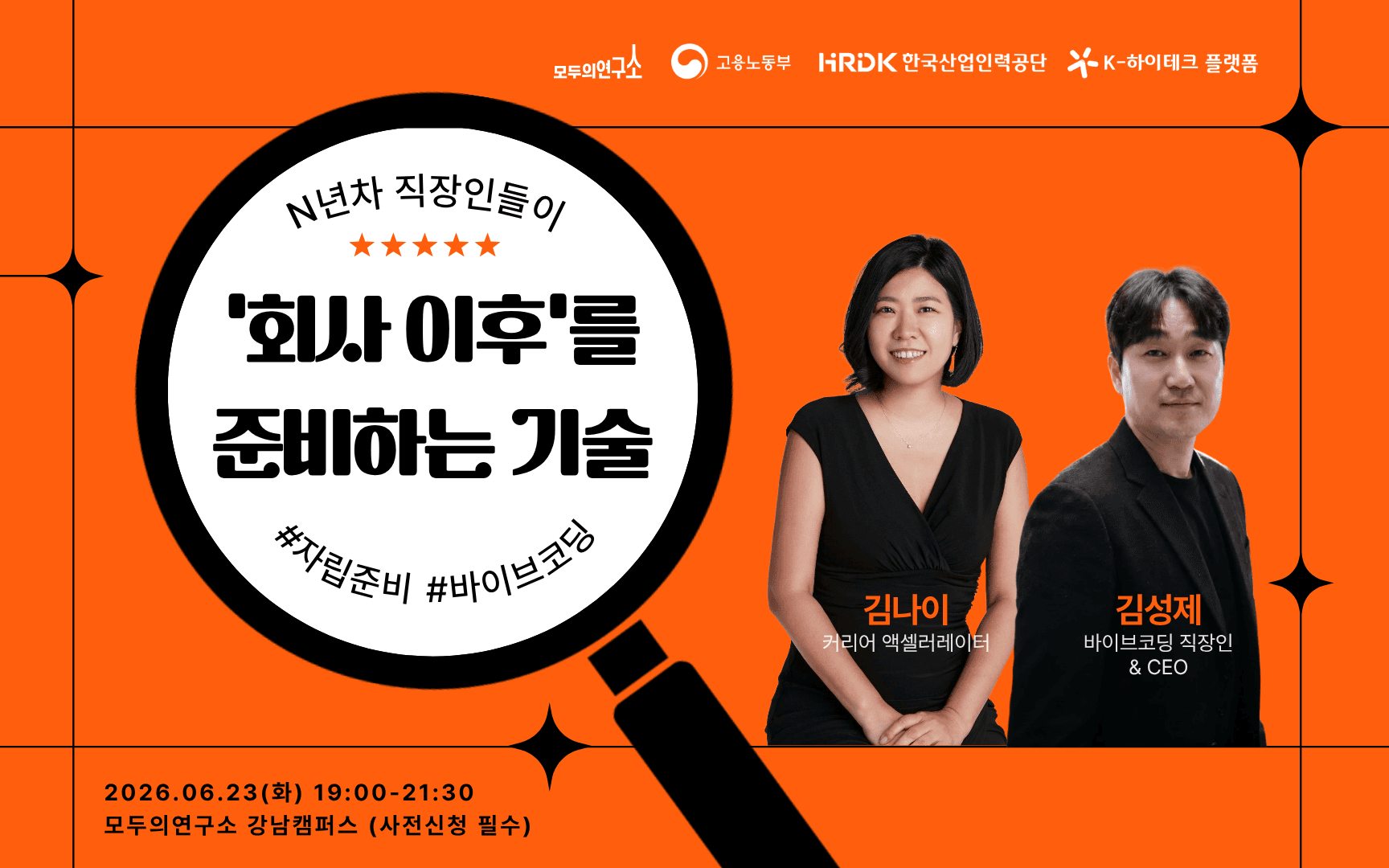

N년차 직장인들이 ‘회사 이후’를 준비하는 기술

6월 23일(화) 19:00 - 21:30강남 캠퍼스모집중- #자립준비

- #스텔스창업

- #바이브코딩

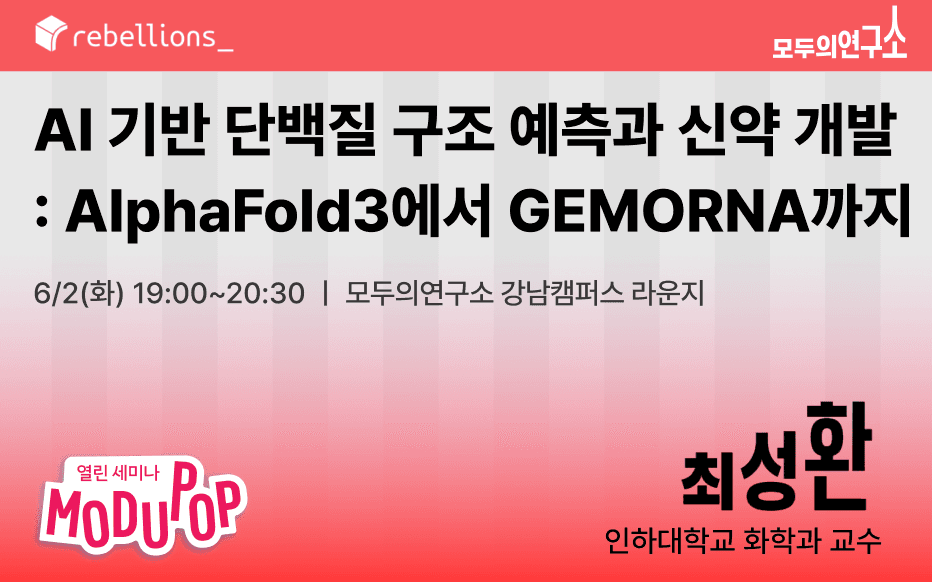

AI 기반 단백질 구조 예측과 신약 개발: AlphaFold3에서 GEMORNA까지

6월 2일(화) 19:00 - 21:00강남 캠퍼스모집중- #ai4science

- #리벨리온

- #단백질구조예측

![[모두팝/온라인] 양자컴퓨터를 활용한 AI 서비스와 글로벌 사례 with D-Wave](/_next/image?url=https%3A%2F%2Fresources-public-prd.modulabs.co.kr%2Fhome-section%2Fmain-seminar%2Ff5d51177-34f6-40fb-ae5c-8a8117d30248.png&w=3840&q=75)

[모두팝/온라인] 양자컴퓨터를 활용한 AI 서비스와 글로벌 사례 with D-Wave

5월 27일(수) 20:00 - 21:40온라인모집중- #양자컴퓨팅

- #노르마

- #D-Wave

모두의 LLM Security: 논문 소개부터 최신 사례까지

4월 28일(화) 19:00 - 21:00강남 캠퍼스모집마감- #안전한MLLM

- #RAG

- #RAGpoisoning

모두의 연구소 LAB

함께하는 모두의 연구실, LAB

Pistar LAB

인공지능을 활용한 퀀트 투자 전략을 연구하는 모임

모집중진행전- ##퀀트투자,#인공지능,#강화학습,#에이전트,#머신러닝

- ##퀀트투자,#인공지능,#강화학습,#에이전트,#머신러닝

코모리친구들 LAB

LLM 기반 대화형 게임으로 히키코모리 친구와 관계를 쌓아 세상 밖으로 이끄는 프로젝트

모집중진행전- #ai

- #llm

- #프롬프트엔지니어링

- #gpt

- #게임

- #심리

- #대화형게임

- #ai

- #llm

- #프롬프트엔지니어링

- #gpt

- #게임

- #심리

- #대화형게임

Hello, NPU LAB

리벨리온 NPU에 AI 모델을 올리고 컴파일, 서빙, 벤치마크해 보는 오프라인 랩

모집중진행전- #llm

- #논문

- #npu

- #vllm

- #triton

- #리벨리온

- #rbln

- #llm

- #논문

- #npu

- #vllm

- #triton

- #리벨리온

- #rbln

LinkMind LAB

개인 지식 데이터베이스를 위한 graphRAG 오픈소스를 개발하는 LAB

모집중진행전- #rag

- #ontology

- #graphrag

- #graphdb

- #rag

- #ontology

- #graphrag

- #graphdb